Darum geht's:

- KI-Programme erleichtern die Erstellung von Bild-, Video- oder Audiomaterial. Das Material wird immer realistischer.

- Dennoch gibt es einige Techniken, wie man solches KI-Material identifizieren kann.

- Dazu gehören die Suche nach der Originalquelle oder logisches Denken.

"Ist das wirklich so passiert oder ist das KI?" Diese Frage erreicht uns beim #Faktenfuchs immer häufiger, seitdem es frei zugängliche Programme gibt, mit denen jeder KI-Inhalte generieren kann.

Es stimmt: Die technischen Entwicklungen im KI-Bereich in den vergangenen Jahren waren rasant. Doch wenn Bilder, Videos oder Audios täuschend echt aussehen oder klingen – auf was kann man sich dann noch verlassen?

- Hier finden Sie #Faktenfuchs-Artikel zum Erkennen von Falschinformationen.

Die gute Nachricht ist: Es gibt einfache Techniken, die dabei helfen können, KI-Material als solches zu identifizieren, damit sicher umzugehen oder zumindest die Seriosität des Materials gut einzuschätzen. Anlässlich des Internationalen Fact-Checking-Tags am 02. April können Sie in diesem #Faktenfuchs einige davon nachlesen.

Tipp 1: Ignorieren ist erlaubt – nicht jeder Inhalt ist wichtig

Der erste Tipp klingt zwar banal, kann aber wirksam sein: Sie müssen nicht jeden Inhalt bewerten, sondern können manche Dinge schlicht ignorieren. Falls Sie ein Bild sehen, das Ihnen KI-generiert erscheint, dann könnten Sie sich fragen: Ist das wichtig für mich persönlich? Will jemand unbedingt meine Aufmerksamkeit? Sollte ich meine Lebenszeit dafür aufwenden? Oder lese ich beispielsweise lieber in meinem Buch weiter?

Die Philosophin Anastasia Kozyreva von der Max-Planck-Gesellschaft forscht zu Falschinformationen und empfiehlt ein solches "Kritisches Ignorieren" '(externer Link). Sie sagt: "Ohne die Fähigkeit, bewusst zu entscheiden, was wir im Netz ignorieren und wohin wir unsere Aufmerksamkeit lenken, lassen wir zu, dass andere die Kontrolle über unsere Augen und unseren Verstand übernehmen."

Tipp 2: Lassen Sie sich Zeit

Auch der zweite Tipp hat nichts mit ausgefeilten Recherchefähigkeiten oder technischen Hilfsmitteln zu tun. Falls Sie Inhalten begegnen, die Ihnen KI-generiert erscheinen, die Sie aufwühlen, wütend werden lassen oder bei denen Sie sich denken "Das kann doch nicht wahr sein!?": Einmal tief durchatmen und Zeit nehmen. Falsch- und Desinformationen knüpfen oft an polarisierende und emotionale Themen an.

Wer Falschinformationen verbreitet, will skandalisieren und setzt darauf, dass Menschen die Inhalte weiterleiten, ohne viel zu überlegen. Halten Sie daher inne, bis Sie für sich selbst folgende Fragen beantwortet haben: Was ist die Aussage des Inhalts? Wer verbreitet den Inhalt? Steht dahinter eine Interessengruppe? Gibt es dafür Belege?

Außerdem können Sie auf folgenden nachgewiesenen psychologischen Effekt achten: Haben Sie zu einem gewissen Thema bereits eine starke Meinung, glauben Sie mit höherer Wahrscheinlichkeit auch Falschinformationen, die Ihre Haltung bestätigt. Die Rolle des sogenannten "confirmation bias"(externer Link), des Bestätigungsfehlers (externer Link), zeigen Studien (externer Link).

Tipp 3: Menschenverstand schlägt Tools

Der dritte Tipp betrifft eine weitere Frage, die uns immer wieder gestellt wird: Gibt es denn kein Programm oder Internet-Werkzeug, das für mich erkennt, ob etwas echt ist? Die Antwort darauf lautet leider: Nein, es gibt noch keine Programme, die durchweg zuverlässig ausspucken: "Dieses Foto ist mit einem KI-Tool bearbeitet."

Fact-Checking-Journalisten benutzen manchmal solche Tools, deren Ergebnisse sind allerdings nur ein Indiz unter mehreren. Die endgültige Bewertung muss am Ende immer noch der Mensch treffen.

Bei unklaren Inhalten sollten Sie deswegen den gesunden Menschenverstand einsetzen und sich fragen: Ergibt das eigentlich Sinn oder ist das wahrscheinlich? Kann dieses Ereignis, wie es das Bild, Video oder Audio beschreibt, wirklich passiert sein?

Josef Holnburger, Geschäftsführer des Think-Tanks "Center für Monitoring, Analyse und Strategie" (CeMAS), beschäftigt sich mit Fälschungen, Falsch- und Desinformation und sagt: "Ich glaube, da ist ein Mensch immer noch besser als KI-Modelle, weil Sinn ergreifen können sie alle noch nicht. Und es ist auch nicht erwartbar oder noch nicht absehbar, dass sie das jemals könnten."

Tipp 4: "Seitwärts-Lesen" hilft bei brisanten Themen

Starten Sie deshalb, wenn Sie sich nicht sicher sind, ob etwas echt ist, zuerst eine eigene, kurze Recherche. Dieses "Seitwärts-Lesen" (externer Link) empfiehlt die Philosophin Anastasia Kozyreva. Bei brisanten Themen oder angeblichen Skandalen: Suchen Sie bei seriösen Quellen wie etwa den großen deutschen Medien nach Berichterstattung. Finden Sie keine weitere seriöse Quelle für eine Behauptung? Dann ist das ein Indiz für eine zweifelhafte Information.

Mit diesen vier grundsätzlichen Hinweisen ausgestattet, können Sie sich nun im Verlauf des weiteren Texts einige Beispiele anschauen. Jedes dieser Beispiele wurde mit KI generiert oder manipuliert und zu allen hat der #Faktenfuchs recherchiert. Anhand dieser Inhalte geben wir Ihnen Tipps dafür, wie man KI-Material identifizieren kann. Die vollständigen Faktenchecks verlinken wir im Text.

Beispiel 1: Originalquelle eines KI-Videos mit Bilderrückwärtssuche finden

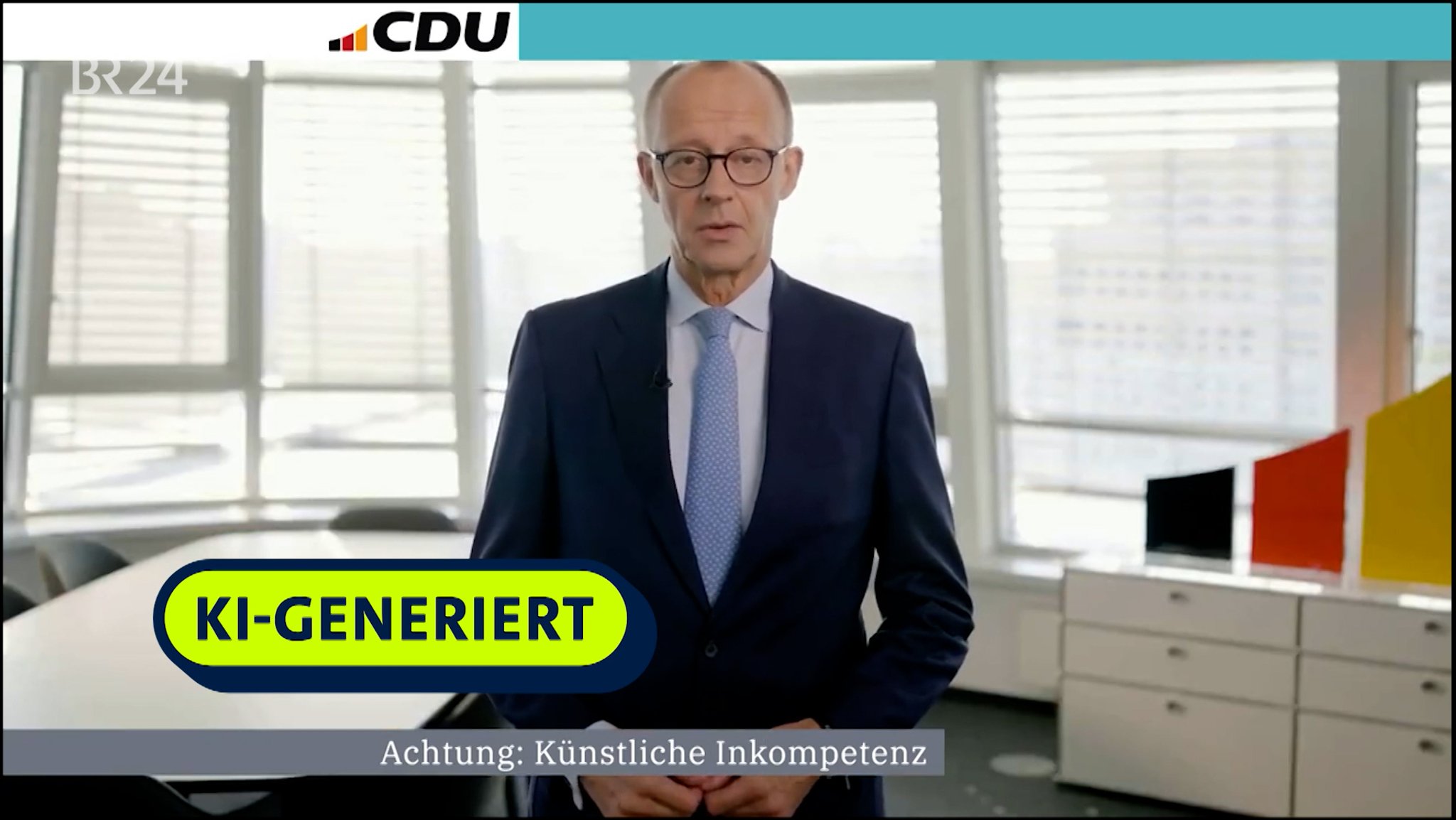

Ende November 2024 teilte der SPD-Bundestagsabgeordnete Bengt Bergt ein Video, das den damaligen CDU-Kanzlerkandidaten Friedrich Merz zeigte. Bergt löschte das Video nach einigen Stunden wieder aus seiner Instagram-Story.

Wenn Sie die ersten Sekunden des Videos anschauen, nehmen Sie sich wie gesagt erst einmal Zeit. Was sagt Friedrich Merz in dem Video? Ist das realistisch, dass Friedrich Merz so etwas sagen würde? Und wer verbreitet das Video? Was kann ich noch darin sehen, was mir bei der Einstufung hilft?

Ein mit KI-Werkzeugen bearbeitetes Video zeigt eine Szene mit Friedrich Merz.

Der erste Hinweis ist der Schriftzug "Achtung: Künstliche Inkompetenz". Auf den zweiten Blick fällt außerdem auf: Merz’ Mundbewegungen passen teilweise nicht mit dem Gesagten zusammen, auch seine Mimik wirkt unnatürlich.

Über eine Bilderrückwärtssuche im Internet fanden wir damals zwei Dinge: Einmal einen Instagram-Account, der das Video verbreitet hatte. In diesem Profil taucht an mehreren Stellen der Begriff "KI" auf. Ein erster Hinweis, dass hier etwas nicht stimmt. Über die Bilderrückwärtssuche fanden wir auch das Originalvideo: Ein Ausschnitt aus dem Video führte zum Youtube-Kanal von Friedrich Merz, wo das echte Video bereits Ende September 2024 hochgeladen wurde. Natürlich mit einem ganz anderen Audio.

So konnten wir also verifizieren: Das Video aus dem November ist ein KI-Fake. Weil das Video nicht ohne weiteres als Fälschung zu erkennen ist, kann man es auch als "Deepfake" (externer Link) bezeichnen.

Beispiel 2: KI-Video erkennbar an unnatürlichen Bewegungen

KI-Tools, die aus einer Texteingabe ganze Videos erstellen, haben derzeit noch mit einer Sache Probleme: Der sogenannten Objektpermanenz. Das ist eigentlich ein Begriff aus der Psychologie. Er besagt, dass Sie ein Objekt nicht sofort vergessen, sobald es aus Ihrem Blickfeld geraten ist.

Bei KI-Videos finden sich häufig aber "Anschlussfehler" bei Objekten, die sich bewegen. Da verschwindet auf einmal ein Bein eines Menschen, das Ohr eines Hundes oder ein ganzes Pferd. Andersherum ploppen solche Dinge aus dem Nichts auf. Beides ist ein Hinweis auf eine Bearbeitung oder Erstellung des Materials mit KI.

Das zeigt das Beispiel eines Videos, welches die AfD Brandenburg im Bundestagswahlkampf verbreitete. Im Video unten sehen Sie einen kurzen Ausschnitt daraus mehrmals in verlangsamter Geschwindigkeit.

Ein mit KI-Werkzeugen erstelltes Video der AfD Brandenburg zeigt eine Szene in einer Kita.

Darin sieht man eine Erzieherin in einer Kita: Die Arm- und Körperhaltung erscheint eigenartig. Achten Sie auf den linken Arm: Darunter ist nur eine Latzhose zu sehen, ein Kind ohne Oberkörper. Im Fortgang sehen Sie, dass aus dem Nichts ein Kind erscheint und die Hand der Erzieherin hält. Hier hatte die KI Probleme, einen sinnvollen Bewegungsfluss zu erstellen.

Weitere Hinweise auf den Einsatz von KI: Die starke Weichzeichnung, die grellen Farben und die ruckeligen Bewegungen der Personen. Das gilt für dieses, wie für die allermeisten derzeit kursierenden KI-generierten Videos. Falls Sie einen entsprechenden Verdacht bei einem Video haben: Achten Sie bei Personen insbesondere auf Hände, Arme und Beine. Wie bewegen sie sich, ruckeln sie unnatürlich und verschwinden Teile des Körpers zwischendurch, verlängern oder verkürzen sich?

In dem Video der AfD kommen ebenso KI-generierte Doubles von zwei Bundesministern vor: Karl Lauterbach wird in Handschellen von Polizisten abgeführt, Robert Habeck ist Müllsammler.

Das Beispiel von Lauterbach zeigt, wie Sie KI-Material auch mit gesundem Menschenverstand identifizieren können. Im Fact-Checking wird das auch "Logik der Verifikation" genannt. Warum hilft diese Szene bei der Einschätzung?

Ein KI-generiertes Video der AfD Brandenburg zeigt Lauterbach in Handschellen und Habeck als Müllsammler.

Stellen Sie sich vor, ein Bundesminister würde tatsächlich am helllichten Tag von der Polizei verhaftet. Würden Sie darüber in den Medien etwas lesen? Natürlich, alle Medien würden darüber berichten, Eilmeldungen versenden, es würde offizielle Stellungnahmen geben.

Ereignisse, die einen hohen Nachrichtenwert haben, können sie also verifizieren, indem sie danach bei anderen seriösen Medien suchen – beispielsweise den Tod eines Papstes oder Katastrophenfälle.

Unter diese Quellenkompetenz fällt auch, dass Sie bei verdächtigen Behauptungen nach Angeboten von Fact-Checkern suchen können. In Deutschland gibt es neben dem BR24 #Faktenfuchs zum Beispiel noch öffentlich-rechtliche Angebote von der Tagesschau (Faktenfinder) und der Deutschen Welle.

Die Fact-Checking-Redaktionen der Deutschen Presse-Agentur (dpa) und von Correctiv sind wie der #Faktenfuchs Mitglied im International Fact-Checking Network (IFCN). Bei weit verbreiteten Behauptungen stehen die Chancen nicht schlecht, dass es dazu bereits einen Faktencheck gibt.

Beispiel 3: KI-Bilder mit Logik erkennen

Die Programme, mit denen man aus Texteingaben Bilder erstellen kann, werden immer besser. In der Vergangenheit waren KI-generierte Bilder regelmäßig erkennbar an fehlerhaften Details, wie den Fingern, Haaren, Zähnen, der Kleidung und Schriftzeichen.

Mittlerweile können KI-Tools bekannte Persönlichkeiten, von denen es viel verfügbares Bildmaterial gibt, sehr realistisch kopieren. Manche Menschen können deswegen KI-Bilder von bekannten Politikern nicht mehr als unecht erkennen, wie diese Beispiele von Bundespräsident Frank-Walter Steinmeier und Karl Lauterbach aus dem Wahlkampf zeigen.

Diese Screenshots zeigen die KI-generierten Bilder von Karl Lauterbach und Frank-Walter Steinmeier, von "Satire"-Accounts veröffentlicht.

Wie schon bei Beispiel 2 beschrieben, kann aber der Einsatz von Logik weiterhelfen. Dazu gehören Fragen wie:

- Ist es plausibel, dass dieses Foto an diesem Ort so geschossen wurde?

- Kann der Fotograf dort überhaupt gestanden haben und das Foto so aufgenommen haben?

- Gibt es weitere Fotos von dem Geschehnis? Warum nicht? Bedenken Sie, heutzutage hat fast jede und jeder ein Smartphone dabei. Bei außergewöhnlichen Ereignissen wäre es wahrscheinlich, dass man im Netz weitere Fotos oder Videos davon findet.

Ein zweiter Blick auf die Quelle lohnt sich ebenfalls oft. Der Account, der das Lauterbach-Bild verbreitete, trägt zum Beispiel den Begriff "Satire" im Namen. Außerdem verbreitet er auf X regelmäßig KI-Bilder oder Videos, die Lauterbach imitieren.

Beispiel 4: Wer spricht da? KI-Audios beim Telefonbetrug

Einen Text eingeben, den eine berühmte Person dann spricht – das geht mit entsprechenden KI-Programmen problemlos. Es braucht lediglich eine Tonaufnahme des Originals, etwa eine Sprachnachricht, manchmal reichen schon einige Sekunden für ein überzeugendes Ergebnis.

Während die Stimm-Klone manchmal noch mechanisch klingen und einige Worte seltsam betonen, werden sie – ähnlich wie die KI-generierten Bilder – mit der Zeit immer authentischer und damit schwerer vom Original zu unterscheiden (externer Link).

Wenn man im Internet auf fragwürdige Audioinhalte von Prominenten stößt, kann es helfen, sich eine echte Aufnahme der Person anzuhören und die Aufnahmen zu vergleichen. Außerdem lohnt es sich, genau hinzuschauen, wer die Audioaufnahme verbreitet hat. Wenn die Quelle, also der Ursprung der Tonaufnahme, unklar ist und sich nicht herausfinden lässt, ist Skepsis angebracht. Ist der Verbreiter der Tonspur bekannt, sollte man schauen, welches Interesse die Person verfolgt.

Solche KI-Audios werden auch für Telefonbetrug genutzt. Wenn angeblich die Tochter von einer unbekannten Nummer aus anruft und um Geld bittet, sollte man auch dann vorsichtig bleiben, wenn die Stimme wirklich nach der Tochter klingt.

Der Experte Aljoscha Burchardt vom Deutschen Forschungszentrum für Künstliche Intelligenz (DFKI) empfahl in einem #Faktenfuchs-Interview in so einem Fall, für einen Rückruf um die Nummer zu bitten und dann zu versuchen, die Tochter unter der eigentlichen Nummer zu erreichen. Auch kann man sich schützen, indem man ein Codewort ausmacht, das man genau in solchen Situationen abfragen kann.

Fazit

KI-Inhalte können Sie teilweise selbst erkennen: Achten Sie dazu auf unnatürliche Bewegungen, auf die Extremitäten oder das Gesicht der dargestellten Menschen. Sie können außerdem Details aus KI-Material selbst mit einer Websuche recherchieren, zum Beispiel, ob seriöse Medien darüber berichten oder ob Sie Informationen über die Verbreiter finden.

Generell helfen Medien- und Quellenkompetenz beim Umgang mit KI-Inhalten: Sie können Inhalte schlicht ignorieren, sich zusätzliche Informationen an anderer Stelle holen und sich Zeit für Ihre Einordnung und Reaktion lassen.

Das ist die Europäische Perspektive bei BR24.

"Hier ist Bayern": Der BR24 Newsletter informiert Sie immer montags bis freitags zum Feierabend über das Wichtigste vom Tag auf einen Blick – kompakt und direkt in Ihrem privaten Postfach. Hier geht’s zur Anmeldung!